400 606 5709

体验 DEMO

400 606 5709

体验 DEMO

400 606 5709

体验 DEMO

400 606 5709

体验 DEMO

2026年3月18日 • 作者:DataPipeline

一、项目背景与目标

某国内头部公募基金管理公司业务覆盖公募基金、专户理财、养老金管理及国际业务,累计服务客户超过1.8亿,资产管理规模超过1.5万亿元。

随着业务规模持续增长和监管环境变化,该基金公司在数据基础设施方面提出了更高要求。原有数据同步体系逐渐难以支撑复杂业务场景与信创环境需求,因此启动实时数据融合平台升级项目,通过引入DataPipeline构建统一、稳定、高效的数据同步体系,为业务系统和数据平台之间的数据流转提供长期稳定的能力支撑。

技术目标

1. 构建信创环境下的实时数据同步能力

适配国产数据库环境,保障关键业务系统在信创体系中的稳定实时数据同步。

2. 建立统一的数据同步与运维体系

整合分散的数据链路,实现统一管理、全链路监控与自动化运维。

业务目标

1. 提升业务数据实时流转效率

通过实时数据同步能力,加快业务数据进入数据平台的速度,支撑分析与运营决策。

2. 打破数据孤岛,提升数据协同能力

整合多源异构系统数据,提升整体数据共享与协同效率。

二、为什么选择DataPipeline

在项目选型阶段,该基金公司围绕产品能力、行业实践与服务支持等多个维度进行了综合评估,最终选择 DataPipeline 作为实时数据融合平台。

· 产品能力成熟稳定

DataPipeline在实时数据同步、异构数据整合与复杂数据链路构建方面具备成熟能力,能够满足金融行业对稳定性与实时性的高要求。

· 行业实践经验丰富

平台已在金融等对数据稳定性要求较高的行业形成较多落地实践,对复杂业务系统环境和数据架构具有较强适配能力。

· 服务与交付能力可靠

项目实施过程中,DataPipeline团队能够结合客户现有系统架构与业务需求提供针对性方案,并在实施与运维阶段持续提供技术支持,保障平台稳定运行。

三、实施方案

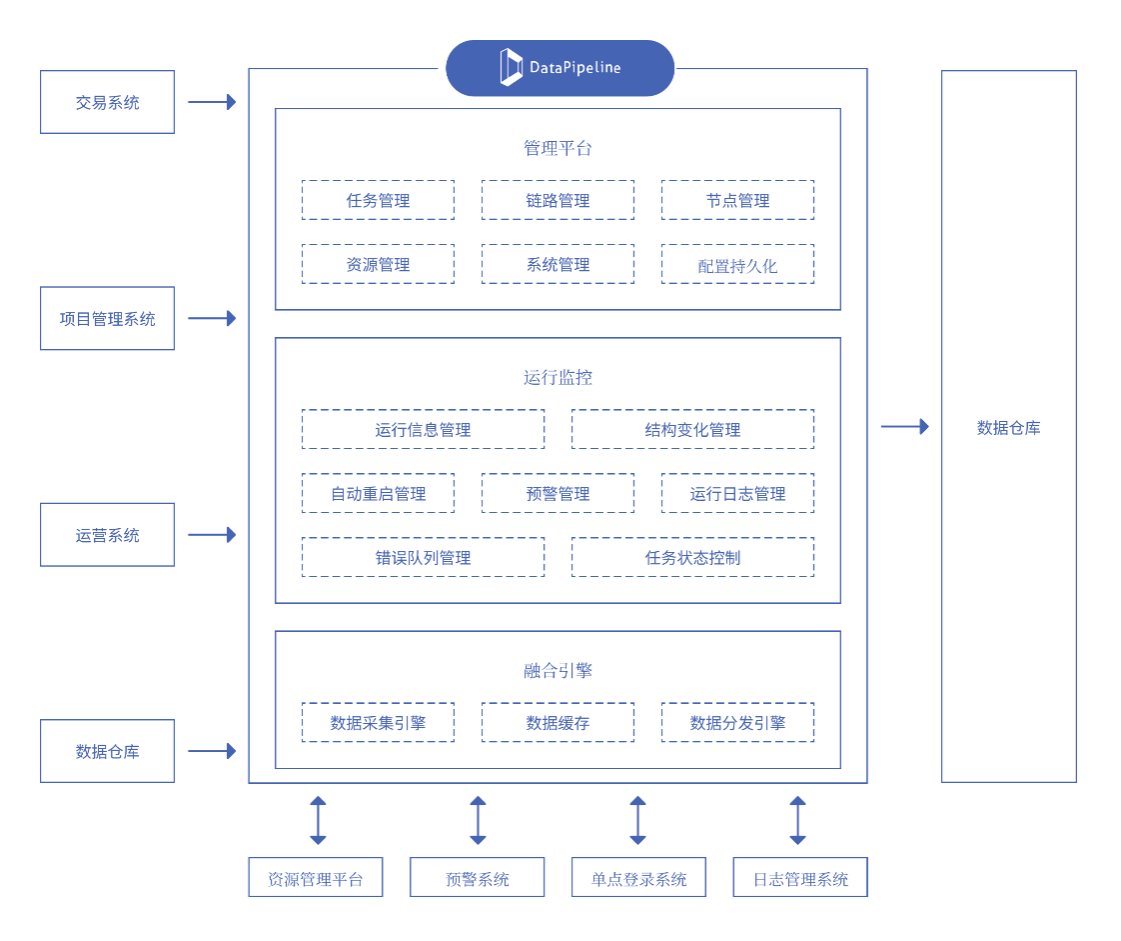

DataPipeline企业级实时数据融合平台对该基金公司现有数据环境进行了全面适配。平台支持与传统关系型数据库、OceanBase、达梦数据库、Transwarp Data Hub(TDH)、GBase 8a 以及 Kafka 等多种数据系统稳定对接,实现交易系统、项目管理系统、运营系统及数据仓库等多源业务系统的数据接入,并将关键业务数据实时同步至数据仓库,为数据平台提供持续稳定的数据来源。

实时数据融合平台架构

▶ 强大的异构数据兼容能力

DataPipeline能够稳定适配多种数据库与数据平台,包括传统关系型数据库以及OceanBase、达梦、GBase 8a、TDH、Kafka等多种国产及主流数据系统,能够满足复杂数据环境下的同步需求。

▶ 高实时性的 CDC 数据同步能力

平台具备成熟的增量数据捕获(CDC)能力,能够在保证数据一致性的前提下,实现秒级延迟的数据同步,为实时数据应用提供基础保障。

▶ 灵活的数据链路构建能力

通过可配置的数据节点与数据任务机制,能够根据业务需求快速构建复杂数据链路,支持多源数据实时融合。

▶ 完整的运维监控体系

平台提供统一可视化管理界面与全链路监控能力,能够快速定位异常并进行自动化运维,显著降低系统维护成本。

四、实施成果

项目上线1年多以来,平台已稳定支撑10多个核心业务系统的数据同步需求,形成多条实时数据链路。系统运行过程中,日志切换日均超过300次,数据同步延迟保持在秒级以内,为企业数据流转提供了稳定可靠的技术支撑。

在项目实施效果方面,该基金公司对平台运行情况给予了积极评价:“DataPipeline成功适配多元异构数据库环境,并在证券基金行业的实际场景中实现稳定应用。平台能够高效处理复杂业务数据,在技术与实践层面都具备良好的推广价值。”

技术层面:构建稳定可控的实时数据同步体系

通过适配多种信创数据库环境,项目在国产化技术体系下建立了稳定可靠的实时数据同步能力。同时依托CDC实时同步机制与统一监控运维体系,实现秒级数据集成与全链路可视化管理,在保障数据一致性的同时显著降低系统运维复杂度。

业务层面:提升数据流转效率与平台支撑能力

项目打通多个业务系统之间的数据链路,实现多源数据的实时汇聚与统一管理,为数据平台持续提供稳定的数据来源。在此基础上,业务数据流转效率得到明显提升,为数据分析、运营管理与业务决策提供了更加及时可靠的数据支撑。

此次完成适配后,双方产品可在企业级应用运行与实时数据流转场景中形成更加顺畅的协同,为客户带来更稳定的系统支撑与更高效的数据链路能力。

在不影响生产系统的前提下,平台实现了不同系统间的数据高效流转,为企业数据基础设施建设提供了可靠支撑。

通过适配多种信创数据库环境,项目在国产化技术体系下建立了稳定可靠的实时数据同步能力。